Qanday qilib firibgarlar oddiy odamlarni puldan mahrum qilish uchun sun’iy intellekt va neyron tarmoqlardan foydalanadilar. Va ularning taktikasidan o’zingizni qanday himoya qilish kerak

seo2025-03-28T12:24:06+05:00Sun’iy intellekt (AI) va neyron tarmoqlarning hali ham kamtarona imkoniyatlari haqidagi maqolalar o’quvchilar orasida jonli javob topmoqda. Buning ajablanarli joyi yo’q – axir, AI ishni sezilarli darajada engillashtirish va pul ishlash imkonini beradi, bu esa firibgarlar tomonidan darhol qo’llanilgan.

Firibgarlar neyron tarmoqlardan qanday foydalanishadi

Neyron tarmoqlar odamlarga muayyan vazifalarni bajarishni osonlashtirishi mumkin. Masalan, ChatGPT va Notion AI har qanday matn, xat, rezyume, insho va hokazolarni yozishi mumkin. Zamonaviy neyron tarmoqlar uchun bu muammo emas. Bundan tashqari, ChatGPT dastur kodini osongina yozishi yoki hatto inson tomonidan yozilgan kodni tahrirlashi mumkin. Bu xususiyat nafaqat dasturchilarning hayotini osonlashtiradi, balki firibgarlar tomonidan ham qo’llaniladi. Kiberxavfsizlik bo’yicha mutaxassislar allaqachon AI-yozma koddan fishing uchun foydalanilgan holatlarni hujjatlashtirishni boshladilar.

Fishing – bu tovlamachilik yoki manipulyatsiya maqsadida bank kartasi va onlayn bank hisob ma’lumotlarini, shuningdek, shaxs haqidagi boshqa ma’lumotlarni o’g’irlashga qaratilgan faoliyat. «Oq» (ya’ni qonuniy) veb-saytlar va to’lov xizmatlarida bu ma’lumotlar himoyalangan va karta to’lovlari uchun xavfsizdir. Biroq, firibgar saytlar o’g’irlangan ma’lumotlardan bank hisobingizni bo’shatish uchun foydalanishi mumkin. Shuning uchun, banklar yoki to’lov tizimlarining xatlari va bildirishnomalari bilan ehtiyot bo’ling va ulardagi havolalarga rioya qilmang.

Sun’iy intellekt va neyron tarmoqlardan foydalangan holda firibgarlik sxemalari

Sun’iy intellekt yaxshilik va yomonlik uchun ishlatilishi mumkin, shuning uchun bu «tadbirkorlar» biz foydalanadigan vositalar yordamida o’z hayotlarini osonlashtirmoqchi bo’lishlari ajablanarli emas.

Har bir inson ularga taqdim etilgan matnni nutqqa aylantiradigan neyron tarmoqlar mavjudligini biladi. Biroq, AI ko’proq narsaga qodir – ular nafaqat taqdim etilgan matnni ovoz chiqaribgina qolmay, balki uni istalgan odamning ovozida ham talaffuz qilishlari mumkin. Va bu haqiqatan ham to’g’ri, buni quyidagi videoni tomosha qilish orqali ko’rishingiz mumkin.

Bu sun’iy neyron tarmoqlarni, jumladan, istalgan matnni istalgan ovoz bilan gapira oladigan sun’iy ovozli neyron tarmoqlarni ishlab chiquvchi kompaniyalardan birining demo-videosi. Bundan tashqari, neyron tarmoq bu ishni juda yaxshi bajaradi va hatto inson ovozining individual xususiyatlarini, masalan, tembr, ohang va boshqa individual xususiyatlarni saqlaydi.

Albatta, bunday yangiliklar xavf-xatarsiz emas. Shu tarzda yaratilgan «ovozli egizaklar» turli maqsadlarda ishlatilishi mumkin. Masalan, ular o’zlarini qarindoshlari yoki do’stlari sifatida ko’rsatib, qurbonlarni chaqirish uchun ishlatilishi mumkin. Ovozni haqiqiydan farqlash juda qiyin bo’lishi mumkin, ayniqsa telefon liniyasi yomon bo’lsa.

Jinoyatchilar ovozlarning audio namunalarini turli yo’llar bilan oladi, masalan, telefon suhbatlari paytida ovoz yozish, ijtimoiy tarmoqlardagi videolardan foydalanish yoki kafe kabi jamoat joylarida ovoz yozish.

Bunday tuzoqqa tushib qolmaslik uchun abonentga qayta qo’ng’iroq qilish va u haqiqatan ham qo’ng’iroq qilganligini tekshirish tavsiya etiladi, ayniqsa suhbat davomida siz shubhali narsa, masalan, qarz olish yoki karta xavfsizlik kodlarini taqdim etish haqidagi so’rovni eshitgan bo’lsangiz.

Biroq, bugungi firibgarlar sun’iy intellektdan foydalanishda yanada uzoqlashdilar. Sun’iy intellektning so’nggi xizmatlari endi nafaqat audio dublni, balki video dublni ham yaratishi mumkin. Firibgarlar o‘z qurbonlarini shantaj qilish maqsadida tanishlaridan pul so‘raydigan, xavfli narsalarni gapiradigan yoki qiladigan videolarni yaratadilar. «Deepfakes» deb nomlanuvchi bunday videolar o’tgan yildan beri internetda paydo bo’lmoqda va sun’iy intellekt juda rivojlangan 2023 yilda qanday bo’lishini tasavvur qilish qiyin emas.

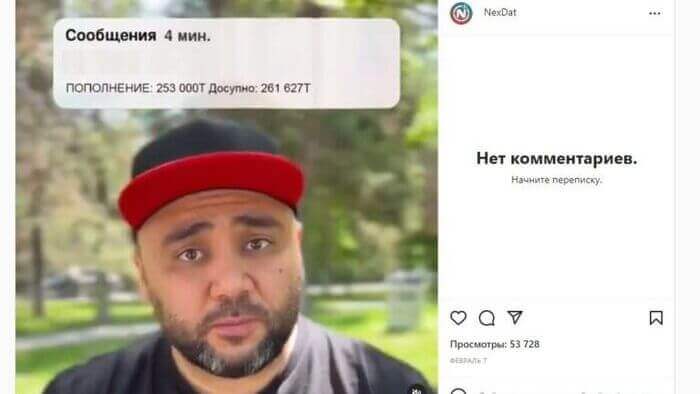

Misol tariqasida, siz ko’p pul ishlashingiz mumkin bo’lgan saytni «ko’rsatadi» deb da’vo qilgan taniqli qozoq blogerini keltirishimiz mumkin. Biroq video soxta bo‘lib chiqdi.

Aldashning boshqa usullari ham bor. Elektron to‘lov bo‘yicha firibgarlar birinchilardan bo‘lib RuNet-da qurbonlarni manipulyatsiya qilish uchun ushbu usuldan foydalanganlar. Ular Instagram’da mashhur yulduzlar tomonidan joylashtirilgan videolardan foydalanib, “yulduzlar” go‘yoki suhbatdoshni “so‘rovnoma o‘tkazib, pul olishga” undagan soxta videolarni yaratishgan.

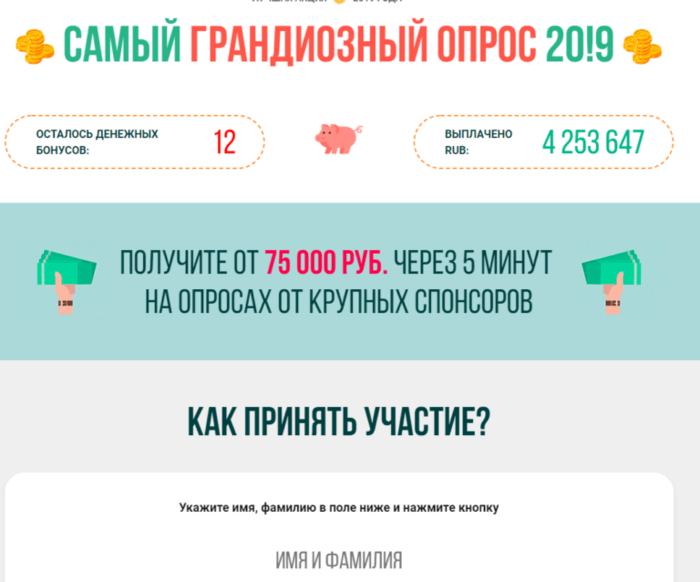

Ushbu soxta videolarni o’z reklamalariga joylashtirish orqali firibgarlar o’zlarining butlariga ishonadigan ko’plab odamlarni jalb qilishlari mumkin. Va jabrlanuvchilar, albatta, hech qachon pul olmaydilar, faqat «to’lovlar, soliqlar va boshqalarni to’lash» uchun mablag’larini yo’qotadilar. va boshqa bahonalar, elektron toʻlovlar boʻyicha firibgarlar oʻzlarining firibgarliklarini yashirish uchun foydalanadilar.

«Eng katta so’rov» birinchi marta «deepfake» elektron to’lov firibgarligida ishlatilgan.

Umuman olganda, ushbu turdagi firibgarliklarga qarshi kurashish bo’yicha maslahatlarimiz oddiy. Agar sizga ovozli xabar kelsa yoki tanishlaringiz messenjer orqali siz bilan bog’lansa va nimadir noto’g’ri ekanini his qilsangiz, ularga keyinroq qo’ng’iroq qiling va so’rovini takrorlash va tushuntirishlarini so’rang. Mashhurlar sizdan biror joyga borishingizni, nimadir o’tkazib yuborishingizni va «pul ishlashingizni» so’ragan reklamani ko’rsangiz, shoshilmang. Bu sizning moliyaviy ahvolingiz va xotirjamlik uchun xavfli bo’lishi mumkin.

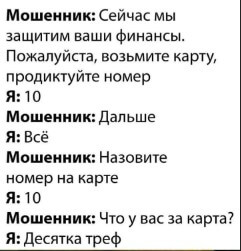

Shuning uchun biz sizga firibgar bilan gaplashganda moliyaviy ahvolingizni himoya qiladigan kulgili maslahat beramiz:

Manba: Pravdorub.

Fikr bildirish

Sharhlash uchun siz saytga kirishingiz lozim.